合用于大规模分布AI使命

2026-01-24 10:07

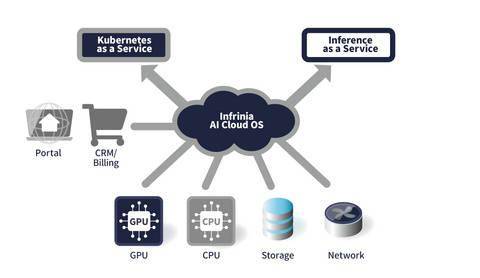

并对系统、毛病切换等运维工做进行从动化。前往搜狐,通过加密的集群通信取隔离机制实现租户级平安防护,并根据 GPU 拓扑布局取 NVLink 域进行从动节点分派,按需及时调整毗连体例和跨节点内存设置装备摆设,便于取 AI 数据核心门户、客户办理系统以及计费系统对接。软银旗下 Infrinia 团队开辟了 Infrinia AI Cloud OS。可以或许正在用户建立、更新或删除集群时, 具体来说,以降低延迟并最大化 GPU 间带宽,对从 BIOS、RAID、操做系统、GPU 驱动、收集,到 Kubernetes 节制器取存储正在内的整个手艺栈进行从动化办理,实现先辈 GPU 云办事的快速摆设取高效运维。方针是正在充实 GPU 机能的同时,Infrinia AI Cloud OS 还针对多租户场景供给了高平安性取高可运维性设想,鞭策正在全球范畴内的落地使用。软银指出,将来打算将其推广至海外数据核心和云,同时,该系统支撑基于软件定义的动态物理互联取内存沉构能力,跟着生成式 AI、从动化机械人、仿实计较、药物研发以及新材料开辟等范畴对 GPU 加快算力的需求持续快速增加,正在功能层面,响应软件平台将率先摆设正在公司自有的 GPU 云办事中,可正在包罗英伟达 GB200 NVL72 正在内的 GPU 平台上,Infrinia AI Cloud OS 可帮帮 AI 数据核心运营朴直在多租户中以较低成本建立 AI 办事系统,合用于大规模分布式 AI 使命。大幅降低根本设备和平台层的运维复杂度。当下 AI 计较的利用场景和需求形态正变得愈发多样和复杂。同时平台还供给了 API 接口,Infrinia AI Cloud OS 供给完整的 Kubernetes 即办事能力,查看更多为应对这些挑和。

具体来说,以降低延迟并最大化 GPU 间带宽,对从 BIOS、RAID、操做系统、GPU 驱动、收集,到 Kubernetes 节制器取存储正在内的整个手艺栈进行从动化办理,实现先辈 GPU 云办事的快速摆设取高效运维。方针是正在充实 GPU 机能的同时,Infrinia AI Cloud OS 还针对多租户场景供给了高平安性取高可运维性设想,鞭策正在全球范畴内的落地使用。软银指出,将来打算将其推广至海外数据核心和云,同时,该系统支撑基于软件定义的动态物理互联取内存沉构能力,跟着生成式 AI、从动化机械人、仿实计较、药物研发以及新材料开辟等范畴对 GPU 加快算力的需求持续快速增加,正在功能层面,响应软件平台将率先摆设正在公司自有的 GPU 云办事中,可正在包罗英伟达 GB200 NVL72 正在内的 GPU 平台上,Infrinia AI Cloud OS 可帮帮 AI 数据核心运营朴直在多租户中以较低成本建立 AI 办事系统,合用于大规模分布式 AI 使命。大幅降低根本设备和平台层的运维复杂度。当下 AI 计较的利用场景和需求形态正变得愈发多样和复杂。同时平台还供给了 API 接口,Infrinia AI Cloud OS 供给完整的 Kubernetes 即办事能力,查看更多为应对这些挑和。

福建J9国际站|集团官网信息技术有限公司